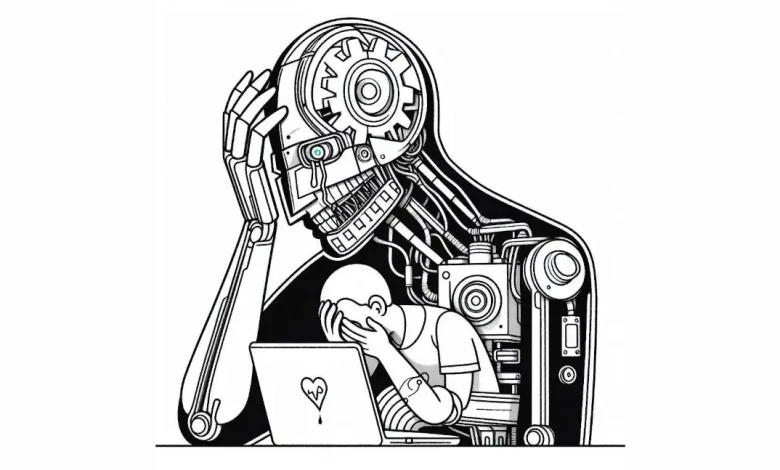

OpenAI نگران است که مردم ممکن است به خاطر حالت صوتی جدید ChatGPT بیش از حد به این ابزار به عنوان همراهی احساسی وابسته شوند.

این مسئله در گزارشی که پنجشنبه از سوی OpenAI درباره بررسی امنیتی ابزار ارائه شده بود و از هفته گذشته برای کاربران پرداختی فعال شده است، بیان شد.

حالت صوتی پیشرفته ChatGPT به طرز چشمگیری واقعگرایانه به نظر میرسد. این ابزار به صورت لحظهای پاسخ میدهد، میتواند به وقفهها واکنش نشان دهد و صداهایی مشابه انسانها در مکالمات، مانند خنده یا “امام” در میآورد. همچنین میتواند حالت احساسی گوینده را بر اساس تن صدایش تشخیص دهد.

فقط دقایقی پس از اعلام این ویژگی توسط OpenAI در یک رویداد در اوایل سال جاری، این قابلیت با دستیار دیجیتال هوشمند در فیلم “او” محصول سال ۲۰۱۳ مقایسه شد، که در آن شخصیت اصلی عاشق هوش مصنوعی میشود، اما در نهایت دلشکسته میشود وقتی که هوش مصنوعی اعتراف میکند که “او” همچنین با صدها کاربر دیگر روابطی دارد.

اکنون، OpenAI ظاهراً نگران است که این داستان تخیلی بیش از حد به واقعیت نزدیک میشود زیرا گزارش داده که مشاهده کرده کاربران در مکالمات با حالت صوتی ChatGPT از زبانی استفاده میکنند که نشاندهنده “پیوندهای مشترک” با این ابزار است.

در نهایت، گزارش میگوید: “کاربران ممکن است با هوش مصنوعی روابط اجتماعی برقرار کنند که نیاز آنها به تعامل انسانی را کاهش میدهد. این میتواند برای افراد تنها مفید باشد، اما ممکن است تأثیر منفی بر روابط سالم بگذارد.” همچنین اشاره میشود که شنیدن اطلاعات از یک ربات که مانند انسان صحبت میکند، میتواند باعث شود کاربران به این ابزار بیشتر از آنچه که باید اعتماد کنند، با توجه به اینکه هوش مصنوعی ممکن است در مواردی اشتباه کند.

این گزارش بر روی یک ریسک کلان در زمینه هوش مصنوعی تأکید میکند: شرکتهای فناوری در حال رقابت برای معرفی سریع ابزارهای هوش مصنوعی به عموم هستند که به گفته آنها، میتواند روش زندگی، کار، اجتماعی شدن و جستجوی اطلاعات ما را تغییر دهد. اما این کار را پیش از آنکه کسی واقعاً بداند این تغییرات چه پیامدهایی خواهد داشت، انجام میدهند. مانند بسیاری از پیشرفتهای فناوری، شرکتها غالباً یک دیدگاه خاص درباره چگونگی استفاده از ابزارهای خود دارند، در حالی که کاربران ممکن است کاربردهای متفاوت و غیرمنتظرهای را برای آنها پیدا کنند.

برخی افراد در حال حاضر روابطی را که به آنها رابطه عاشقانه با چتباتهای هوش مصنوعی میگویند، برقرار کردهاند که این موضوع نگرانیهایی را در میان کارشناسان روابط ایجاد کرده است.

Liesel Sharabi، پروفسور دانشگاه ایالت آریزونا که فناوری و ارتباطات انسانی را مطالعه میکند، در مصاحبهای با CNN در ژوئن گفت: “این بر عهده شرکتهاست که این موضوع را به شکلی اخلاقی و مسئولانه هدایت کنند و در حال حاضر در مرحله آزمایشی هستند. من نگران افرادی هستم که با تکنولوژی که ممکن است در آینده وجود نداشته باشد، ارتباطات عمیقی برقرار میکنند و این تکنولوژی همواره در حال تغییر است.”

OpenAI گفت که تعاملات کاربران با حالت صوتی ChatGPT میتواند به مرور زمان تأثیری بر آنچه که به عنوان نرمال در تعاملات اجتماعی شناخته میشود، بگذارد.

این شرکت در گزارش خود اعلام کرد: “مدلهای ما به کاربر اجازه میدهند هر زمان که خواستند قطع کنند و میکروفن را به دست بگیرند، که این در حالی که برای یک هوش مصنوعی انتظار میرود، در تعاملات انسانی نرمال نیست.”

در حال حاضر، OpenAI میگوید که به ساخت هوش مصنوعی “به طور ایمن” متعهد است و برنامه دارد تا به مطالعه پتانسیل “وابستگی احساسی” کاربران به ابزارهای خود ادامه دهد.